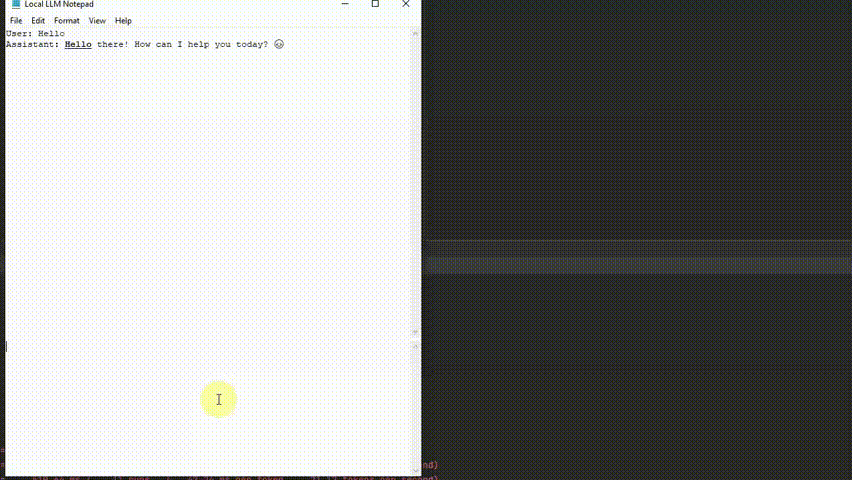

Local LLM Notepad

综合介绍

Local LLM Notepad是一个开源的本地大语言模型运行工具,它被设计为一个完全离线、无需安装的便携式应用程序。用户可以将这个软件放在U盘里,在任何一台Windows电脑上直接双击运行,实现与本地大语言模型的对话、写作或头脑风暴。它的核心特点是便携性和易用性,不需要网络连接、不需要管理员权限,甚至不需要高性能GPU。软件通过一个简洁的窗口提供服务,用户在下方输入问题,在上方查看模型生成的内容。该工具还内置了多个实用功能,例如,它会自动高亮模型回答中引用了用户提问的词语,方便进行事实核对。所有对话记录都可以一键保存和加载,方便用户随时继续之前的工作。

功能列表

- 完全便携:程序本身是一个

.exe文件,可以和模型文件一起存放在U.S.B闪存驱动器中,在任何Windows电脑上即插即用。 - 离线运行:无需网络连接即可使用,确保了数据隐私和在无网络环境下的可用性。

- 无需安装:双击

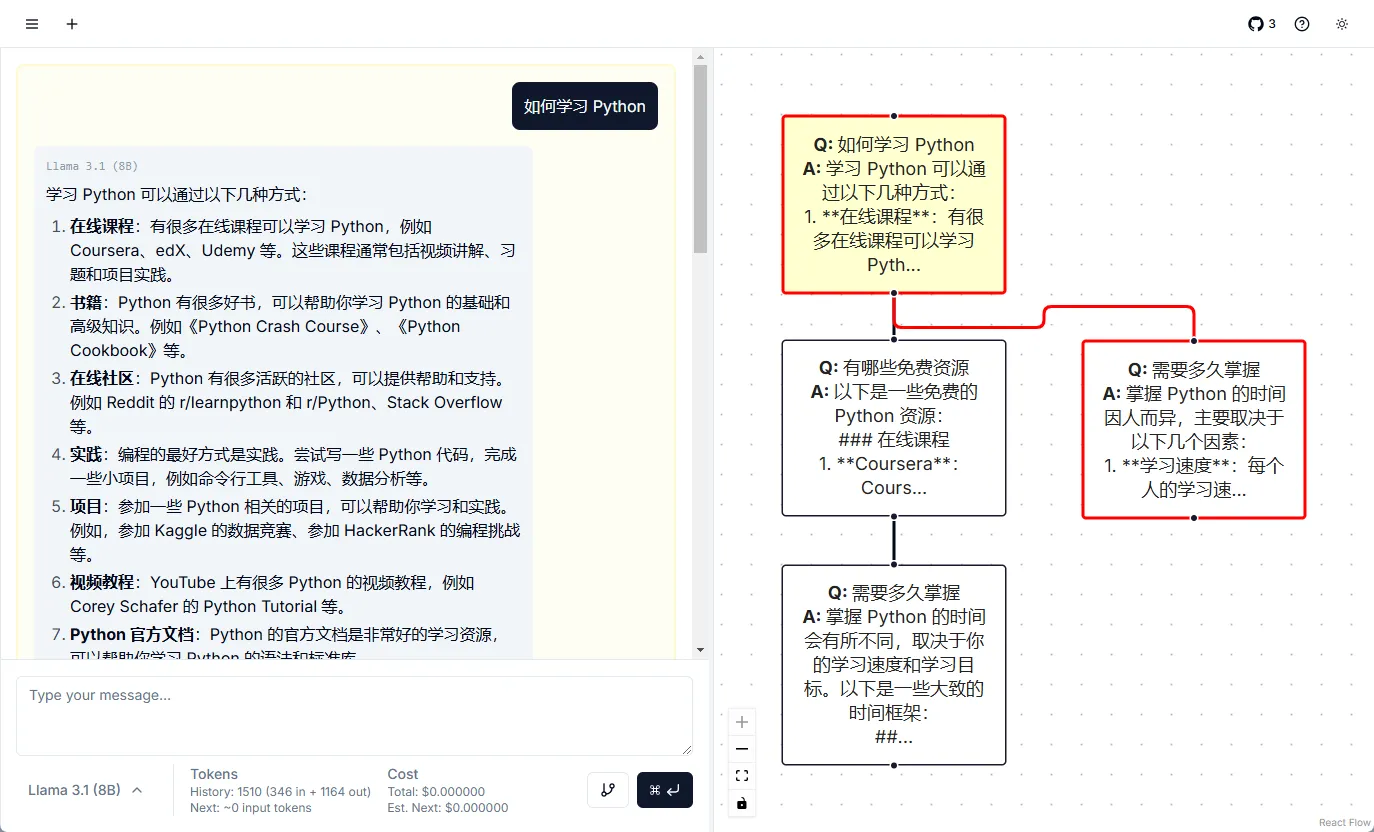

.exe文件即可直接启动,不需要复杂的安装过程,也无需获取系统管理员权限。 - 简洁界面:采用经典的两栏布局,上方为模型回答区,下方为用户输入区,界面干净,没有多余元素干扰。

- 来源词高亮:在模型生成的回答中,会自动加粗并用下划线标出用户输入提示词里的原文,方便快速溯源和核对信息。

- 对话历史管理:支持一键将当前对话保存为

JSON文件,也支持随时加载之前保存的对话记录。 - 兼容多种模型:基于

Llama.cpp开发,支持加载GGUF格式的开源模型,用户可以根据需要自由更换。 - CPU优先:默认使用CPU进行计算,以保证在没有高端独立显卡的普通电脑上也能流畅运行。

- 丰富的快捷键:

Ctrl + S: 发送当前输入的内容给模型。Ctrl + Z: 立即停止模型生成内容。Ctrl + F: 在对话历史中进行内容查找。Ctrl + X: 清空当前的对话历史。Ctrl + P:随时编辑系统提示词(System Prompt)。Ctrl + 鼠标滚轮: 缩放界面字体大小。

使用帮助

Local LLM Notepad的设计目标是让用户能够以最简单的方式在本地计算机上运行大语言模型,无需复杂的配置。

### 准备工作

开始使用前,你需要准备两样东西:

- 主程序:从项目的 "Releases" 页面下载名为

Local_LLM_Notepad-portable.exe的文件。这是一个约45MB的可执行文件。 - 模型文件:你需要一个兼容

Llama.cpp的GGUF格式模型文件。项目推荐初次使用的用户下载gemma-3-1b-it-Q4_K_M.gguf模型,它体积较小(约0.8GB),在普通CPU上也能达到不错的响应速度。

将下载好的.exe程序和.gguf模型文件复制到同一个文件夹中,例如你的U盘根目录。

### 快速上手

- 启动程序:在任何一台Windows电脑上,直接双击

Local_LLM_Notepad-portable.exe文件。 - 加载模型:程序启动后,会自动寻找并加载与它在同一目录下的

.gguf模型文件。首次启动时,程序会将模型加载到内存中,这个过程可能需要一些时间,具体取决于模型大小和电脑性能。 - 开始对话:模型加载完成后,你就可以在下方的输入框中输入文字(例如,提问、写一段开头),然后按下快捷键

Ctrl + S。程序会将你的输入发送给模型,并在上方的窗口中实时展示模型生成的回答。

### 详细功能操作

1. 更换模型如果你有多个不同的GGUF模型文件,可以通过程序菜单栏的File > Select Model…选项来切换。点击后,程序会弹出一个文件选择窗口,你只需找到并选中你想要加载的另一个.gguf文件即可。

2. 溯源与核对 (Source-word under-lining)这是一个非常有用的特色功能。当你向模型提问后,在模型生成的答案里,所有引用了你问题中出现过的词语或数字,都会被自动**加粗并附带下划线**。如果你想知道某个高亮词语的具体来源,只需按住Ctrl键,然后用鼠标左键点击那个词。程序会弹出一个侧边小窗口,清晰地列出你之前所有包含该词的提问记录。这个功能在进行信息汇总、数据提取或事实核对时非常方便。

3. 对话管理

- 保存对话:当你与模型进行了一段有价值的对话后,可以点击菜单栏的

File > Save chat history。程序会将完整的对话(包括你的提问和模型的回答)保存为一个.json文件。你可以将这个文件与程序一起保存在U盘里。 - 加载对话:若要继续之前的对话,只需点击

File > Load chat history,然后选择之前保存的.json文件即可恢复所有聊天记录。 - 清空对话:如果想开始一段全新的对话,可以按下

Ctrl + X快捷键,当前窗口的所有对话记录会被立即清空。

4. 编辑系统提示词系统提示词(System Prompt)可以用来设定模型的角色或回答风格。按下Ctrl + P快捷键,可以随时打开编辑窗口,修改当前的系统提示词,以引导模型产生更符合你需求的输出。

5. 自定义图标如果你希望程序在文件夹中显示一个特定的图标,可以找一张.png格式的图片,将其命名为Icon.png,并与.exe文件放在同一目录下。程序启动时会自动加载这个图片作为图标。

应用场景

- 注重隐私的个人助理用户可以在完全断网的个人电脑上,使用该工具起草邮件、撰写报告、翻译文本或进行创意思考。由于全程离线,所有对话内容都保留在本地,无需担心商业机密或个人隐私泄露。

- 移动办公和学习工具将程序和模型文件存入U盘,即可拥有一个随身携带的AI助手。无论是在图书馆、客户公司还是临时借用的电脑上,都可以即插即用,进行资料查询、代码编写或学习辅导,无需依赖网络或在他人电脑上安装任何软件。

- 无网络环境下的信息处理对于需要在野外、偏远地区或特定安全区域(如机房)工作的工程师、研究人员或技术人员,这个工具提供了一个可靠的本地智能问答和文本处理能力。

QA

- 这个工具支持哪些操作系统?目前仅支持Windows操作系统,因为主程序是

.exe格式。 - 我需要什么样的电脑配置才能运行它?该工具的核心优势在于对硬件要求不高。它默认使用CPU进行运算,因此不需要昂贵的独立显卡(GPU)。基本上,任何一台近些年生产的、可以流畅运行Windows 10或Windows 11的电脑都可以使用它。模型的响应速度主要取决于CPU的性能。

- 我可以从哪里下载到更多的

GGUF模型文件?你可以从Hugging Face社区寻找并下载GGUF格式的模型。在网站上筛选GGUF标签,可以找到大量不同大小、不同语言和不同用途的开源模型,例如Llama、Gemma、Mistral等系列的各种版本。 - 为什么我双击程序后,它需要一段时间才有反应?这是正常的。首次启动或更换模型后,程序需要将整个模型文件从硬盘加载到电脑的内存(RAM)中。这个过程被称为“缓存模型”,所需时间取决于模型文件的大小和你电脑硬盘的读取速度。一旦模型加载完成,后续的提问和回答就会非常迅速。